La expansión de la inteligencia artificial generativa (IA generativa) es innegable. Se integra en una amplia gama de productos y servicios, prometiendo transformar la forma en que interactuamos con la tecnología. Pero, ¿qué puede hacer realmente la IA generativa por el usuario promedio en este momento? Google busca responder a esta pregunta con Gemini para Home, una integración de Gemini en dispositivos domésticos inteligentes.

Esta integración, dirigida a suscriptores del plan de historial de video extendido de la aplicación Home, ofrece resúmenes diarios, notificaciones etiquetadas por IA y otras funciones. Si bien la capacidad de un modelo de IA como Gemini para reconocer eventos en videos y responder preguntas sobre ellos parece factible, Gemini para Home ha demostrado inconsistencias en su comprensión de la realidad, lo que puede generar interacciones inquietantes, como alertas periódicas de intrusiones, tanto humanas como animales.

Si bien ofrece algunas funciones interesantes, surge la pregunta de si los beneficios justifican el costo y las posibles complicaciones.

¿Es Necesaria una Suscripción Premium de IA para tu Hogar Inteligente?

El uso básico de la aplicación Google Home para controlar dispositivos no implica la integración de Gemini. Esta funcionalidad es parte de un servicio pago de nivel superior que incluye historial de cámara extendido y funciones de Gemini, con un costo mensual. Esta suscripción permite que un modelo de IA de Gemini analice el video, generando resúmenes para notificaciones y un “Resumen Diario” que detalla los eventos del día. Un plan más económico ofrece menos historial de video y carece de resúmenes o notificaciones asistidos por IA. Ambos planes habilitan Gemini Live en altavoces inteligentes.

Google afirma que no todo el video se envía a Gemini, sino solo clips de eventos específicos. Estos resúmenes se utilizan para crear el Resumen Diario, que generalmente consiste en una lista de personas que entran y salen de habitaciones, entregas de paquetes y actividades similares.

Es importante destacar que el modelo Gemini que impulsa esta experiencia no es multimodal; solo procesa elementos visuales de los videos y no integra el audio de las grabaciones. Esto significa que ruidos o conversaciones inusuales capturados por las cámaras no se pueden buscar ni se reflejan en los resúmenes de la IA. Esto podría ser una medida intencional para proteger la privacidad de las conversaciones.

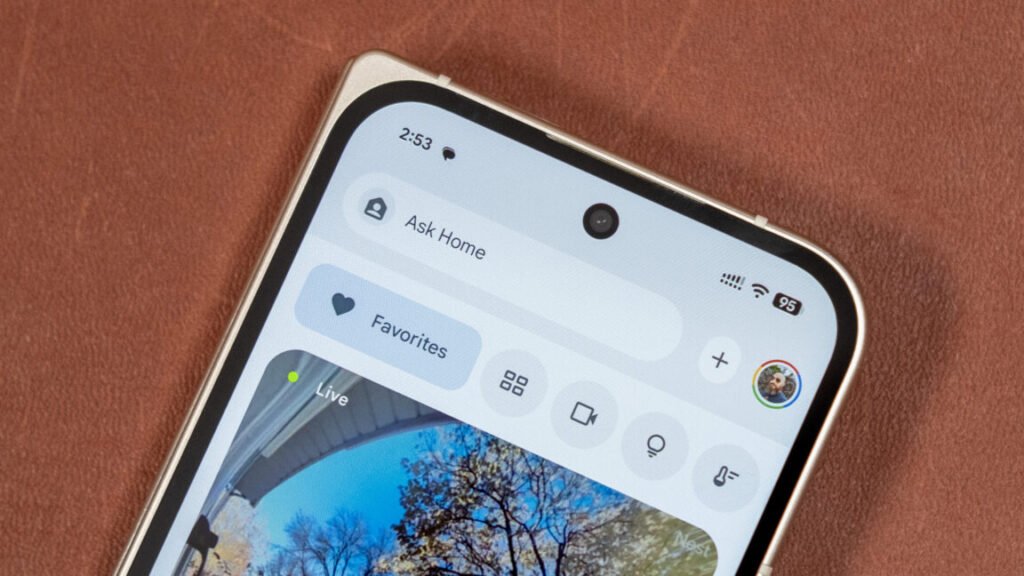

La suscripción con IA también incluye “Ask Home”, un chatbot conversacional que puede responder preguntas sobre lo que ha sucedido en el hogar basándose en el estado de los dispositivos inteligentes y las grabaciones de video. Permite a los usuarios preguntar sobre eventos, recuperar videoclips y crear automatizaciones.

Si bien Gemini tiene algunas dificultades para comprender el video, Ask Home sobresale en la creación de automatizaciones. Aunque la aplicación Home anterior permitía configurar automatizaciones, la IA actualizada puede crear automatizaciones basadas en solicitudes en lenguaje natural. Gracias al conjunto limitado de elementos de automatización posibles, la IA suele acertar. Ask Home también puede encontrar clips de eventos pasados, siempre que la solicitud sea específica.

El plan Avanzado de Gemini Home conserva los videos durante un período limitado, lo que restringe las consultas del robot a clips de ese período. Google también asegura que no retiene ningún video para fines de entrenamiento, a menos que el usuario elija “prestarlo” a través de una opción específica en la aplicación Home. En este caso, Google conservará los videos hasta que se revoque el acceso. Sin embargo, las interacciones con Gemini, como las indicaciones escritas y las calificaciones de los resultados, se utilizan para perfeccionar el modelo.

El Caso del Ciervo Inesperado

Todos los bots de IA generativa cometen errores ocasionales, pero estos errores son más evidentes cuando la IA alucina sobre la vida cotidiana del usuario. En el caso de Gemini para Home, la configuración del hogar inteligente, que incluye cámaras exteriores e interiores, está diseñada para monitorear a las mascotas. Por lo tanto, la IA debería ser capaz de resumir de manera confiable las actividades de los perros.

Sin embargo, en un Resumen Diario, Gemini identificó “inesperadamente, un ciervo entró brevemente en la sala familiar”.

Si bien Gemini reconoció que la aparición de un ciervo en la sala familiar sería inusual, el “ciervo” era, en realidad, un perro. Este error no fue un incidente aislado; Gemini a veces identifica correctamente a los perros, pero con frecuencia informa sobre la aparición de ciervos alrededor de la casa y el jardín.

Este incidente sirve como un recordatorio de que este tipo de IA no “piensa”, a pesar del uso del término “pensamiento” para describir el razonamiento simulado. Una persona que mira el video no consideraría la posibilidad de que estuviera viendo un ciervo después de ver a los perros en otros videos. Gemini carece de ese sentido común básico. Si los tokens dicen ciervo, entonces es un ciervo. Sin embargo, Gemini es excelente para reconocer modelos de automóviles y logotipos de marcas.

Si bien la confusión de animales no es ideal, no representa un obstáculo importante para la usabilidad. El usuario no consideró seriamente la posibilidad de que un ciervo hubiera entrado en la casa, y resulta cómico que el informe diario continúe expresando asombro por la invasión de la vida silvestre. Es un error bastante inofensivo.

Según un portavoz de Google, la precisión general de la identificación depende de varios factores, incluidos los detalles visuales disponibles en el clip de la cámara para que Gemini los procese. Como modelo de lenguaje grande, Gemini a veces puede cometer errores inferenciales, lo que lleva a estas identificaciones erróneas, como confundir un perro con un gato o un ciervo.

Google también afirma que es posible ajustar la IA corrigiéndola cuando comete errores. Si bien esto funciona a veces, el sistema no comprende realmente nada; eso está más allá de las capacidades de un modelo de IA generativa. Después de indicarle a Gemini que está viendo perros en lugar de

Fuente original: ver aquí