La mayoría de los interfaces cerebro-computadora (BCIs) experimentales utilizados para sintetizar el habla humana se han implantado en áreas del cerebro que traducen la intención de hablar en acciones musculares. Un paciente debe intentar físicamente hablar para que estos implantes funcionen, lo que resulta agotador para las personas con parálisis severa.

Para abordar este problema, investigadores de la Universidad de Stanford desarrollaron un BCI que puede decodificar el habla interna, aquella que utilizamos durante la lectura silenciosa y en nuestros monólogos internos. Sin embargo, estos monólogos internos a menudo incluyen pensamientos que no deseamos que otros escuchen. Para evitar que su BCI revelara los pensamientos más privados de los pacientes, los investigadores diseñaron una salvaguarda de “privacidad mental” pionera.

Señales superpuestas

La razón por la que casi todos los prótesis neuronales utilizadas para el habla están diseñadas para decodificar el habla tentativa es que inicialmente se pensó en aplicar el mismo enfoque que se utilizó para controlar extremidades artificiales: grabar desde el área del cerebro responsable del control muscular. “Los movimientos intentados producen señales muy fuertes, y pensamos que también podrían usarse para el habla”, explica Benyamin Meschede Abramovich Krasa, un neurocientífico de Stanford que, junto con Erin M. Kunz, fue coautor del estudio.

El tracto vocal depende, en última instancia, del movimiento de los músculos. Extraer las señales en el cerebro que activan estos músculos parecía una buena manera de sortear el desafío de decodificar el procesamiento del lenguaje de alto nivel que aún no comprendemos completamente.

Sin embargo, para las personas que sufren de ELA o tetraplejia, intentar hablar es un verdadero esfuerzo. Por esta razón, el equipo de Krasa cambió de rumbo y trató de decodificar el habla interna o silenciosa, que nunca activa los músculos.

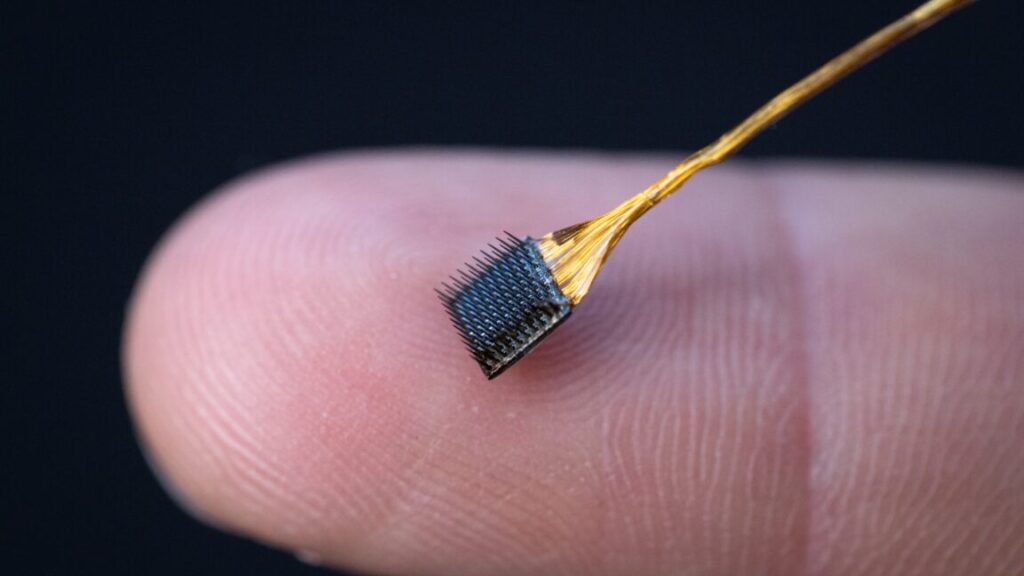

El trabajo comenzó con la recopilación de datos para entrenar algoritmos de IA que debían tomar las señales neuronales involucradas en el habla interna y traducirlas en palabras. El equipo trabajó con cuatro participantes, cada uno casi completamente paralizado, que tenían arreglos de microelectrodos implantados en diferentes áreas de la corteza motora. Se les asignaron tareas que incluían escuchar palabras grabadas o participar en lectura silenciosa.

Basándose en estos datos, el equipo encontró representaciones del habla interna en las señales grabadas en las mismas regiones del cerebro que son responsables del habla tentativa. Esto planteó inmediatamente la pregunta de si un sistema entrenado para decodificar el habla tentativa podría, a veces, captar el habla interna por accidente. El equipo probó esto con un sistema de decodificación de habla tentativa que habían desarrollado en uno de sus estudios anteriores, y resultó que efectivamente podía.

“Demostramos que los sistemas BCI tradicionales entrenados en el habla tentativa podían activarse cuando un sujeto estaba mirando una oración en la pantalla e imaginaba hablar esa oración en su cabeza”, explica Krasa.

Contraseñas mentales

La idea de extraer palabras y oraciones directamente de nuestros pensamientos conlleva preocupaciones de privacidad, especialmente dado que nuestro conocimiento sobre el cerebro es aún muy limitado. En junio de 2025, cuando se demostró un sistema que podía traducir señales cerebrales en sonidos en la Universidad de California-Davis, Ars preguntó a Maitreyee Wairagkar, una investigadora de neuroprótesis que lideró este esfuerzo, cómo su BCI podría diferenciar entre el habla interna y la tentativa. Ella respondió que no era un problema porque estaban grabando señales de la región del cerebro responsable del control muscular.

“Para ser justos, la decodificación accidental del habla interna no ocurrió en su estudio”, dice Krasa. “Pero teníamos la corazonada de que podría ser posible, y así fue.” Por lo tanto, su equipo ideó dos salvaguardas diferentes contra esto.

Una solución para los BCIs de habla tentativa funcionaba automáticamente y se basaba en captar diferencias sutiles entre las señales cerebrales del habla tentativa y la interna. “Si incluías señales de habla interna y las etiquetabas como silenciosas, podrías entrenar redes neuronales decodificadoras de IA para ignorarlas, y eran bastante buenas en eso”, dice Krasa.

Su salvaguarda alterna era un poco menos fluida. El equipo de Krasa simplemente entrenó a su decodificador para reconocer una contraseña que los pacientes debían imaginar hablar en sus cabezas para activar la prótesis. La contraseña era “Chitty chitty bang bang”, que funcionaba como el equivalente mental de decir “Hey Siri”. La prótesis reconocía esta contraseña con un 98 por ciento de precisión.

Sin embargo, tuvo dificultades con frases más complejas.

Avanzando en la frontera

Una vez que se estableció la salvaguarda de privacidad mental, el equipo comenzó a probar su sistema de habla interna con palabras indicadas primero. Los pacientes se sentaron frente a una pantalla que mostraba una oración corta y debían imaginar decirla. El rendimiento varió, alcanzando un 86 por ciento de precisión con el paciente de mejor rendimiento y con un vocabulario limitado de 50 palabras, pero cayendo al 74 por ciento cuando el vocabulario se amplió a 125,000 palabras.

Sin embargo, cuando el equipo pasó a probar si la prótesis podía decodificar el habla interna no estructurada, las limitaciones del BCI se hicieron bastante evidentes.

La primera prueba de habla interna no estructurada involucró observar flechas apuntando hacia arriba, a la derecha o a la izquierda en una secuencia en la pantalla. La tarea consistía en repetir esa secuencia después de un breve retraso utilizando un joystick. Se esperaba que los pacientes repitieran en sus cabezas secuencias como “arriba, derecha, arriba” para memorizarlas; el objetivo era ver si la prótesis lo captaría. Lo hizo en cierta medida, pero el rendimiento fue apenas superior al nivel de azar.

Finalmente, Krasa y sus colegas intentaron decodificar frases más complejas sin indicaciones explícitas. Le pidieron a los participantes que pensaran en el nombre de su comida favorita o recordaran su cita favorita de una película. “Esto no funcionó”, dice Krasa. “Lo que salió del decodificador era un tipo de galimatías.”

En su estado actual, Krasa considera que la prótesis neural de habla interna es una prueba de concepto. “No pensábamos que esto fuera posible, pero lo logramos y eso es emocionante. Sin embargo, las tasas de error eran demasiado altas para que alguien la usara regularmente”, dice Krasa. Sugirió que la limitación clave podría estar en el hardware: el número de electrodos implantados en el cerebro y la precisión con la que podemos grabar la señal de las neuronas. Las representaciones del habla interna también pueden ser más fuertes en otras regiones del cerebro que en la corteza motora.

El equipo de Krasa está actualmente involucrado en dos proyectos que surgieron de la prótesis neural de habla interna. “El primero plantea la pregunta de cuán rápido sería un BCI de habla interna en comparación con una alternativa de habla tentativa”, dice Krasa. El segundo se centra en personas con una condición llamada afasia, donde las personas tienen control motor de sus bocas pero no pueden producir palabras. “Queremos evaluar si la decodificación del habla interna les ayudaría”, añade Krasa.

Cell, 2025. DOI: 10.1016/j.cell.2025.06.015

Fuente original: ver aquí